Вопрос или проблема

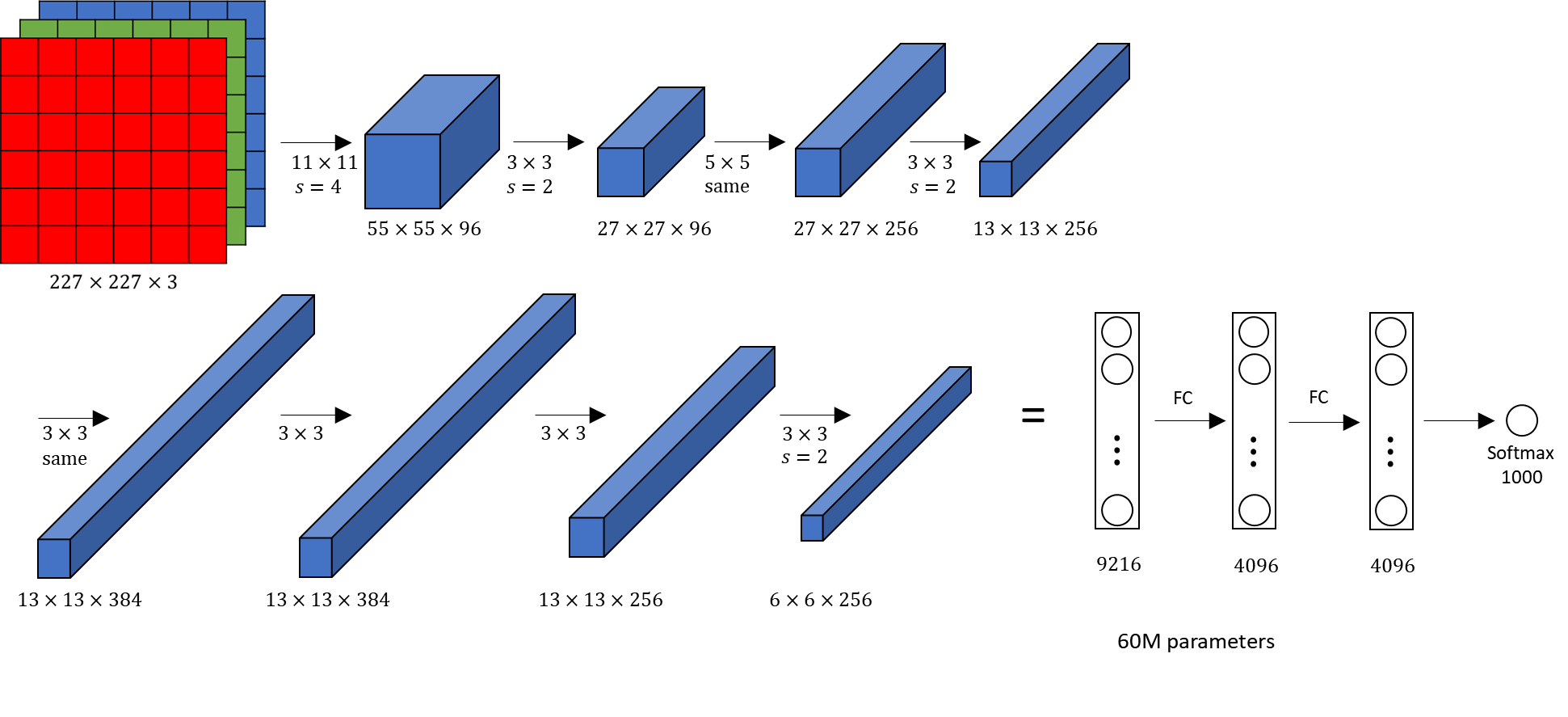

В модели Alexnet, после завершения шагов кодировщика, вы получаете тензор 6x6x256. Теперь его необходимо “развернуть” (flatten) перед переходом к части сети ANN. Однако разворачивание приводит к длине 4096. Как размер тензора уменьшился? В нескольких учебниках я читал о таких шагах разворачивания, обычно при разворачивании тензора размер не теряется, поэтому я ожидал, что длина развёрнутого вектора будет 6 * 6 * 256, т.е. 9216. Почему разворачивание в Alexnet приводит к 4096, а не к 9216?

В статье о Alexnet детали отдельных слоёв сети не разбираются.

Спасибо

Сначала я тоже запутался, но, взглянув на некоторые изображения архитектуры модели, решение стало довольно ясным:

(источник https://iz6.ru/wp-content/uploads/2025/01/alexnet_ispravljeno.png)

(источник https://iz6.ru/wp-content/uploads/2025/01/alexnet_ispravljeno.png)

Последний сверточный слой с выходом 6x6x256 разворачивается в одномерный вектор с n=9216 (как вы уже правильно сказали). НО эти 9216 нейронов идентичны нейронам в сверточном блоке. Это не новые нейроны! разворачивание сделано для лучшего понимания того, как каждый из этих 9216 нейронов подключен к нашему полносвязанному слою с 4096 нейронами.

Ответ или решение

Алекснет, одна из первых глубоких сверточных нейронных сетей, произвела революцию в области компьютерного зрения. Чтобы ответить на ваш вопрос, давайте подробно рассмотрим, как выполняется операция преобразования тензора размером 6x6x256 в вектор длины 4096.

Детали преобразования

-

Сверточные слои и особенности вывода:

В сети Алекснет сверточные слои трансформируют исходные изображения через серию операций свертки и субдискретизации (пулинг), обеспечивая постепенное уменьшение размеров пространственных данных и увеличение количества каналов. На выходе последнего сверточного слоя мы имеем тензор 6x6x256. -

Процесс "разворачивания" (флэттениг):

Обычно процесс преобразования заключается в "разворачивании" тензора в одномерный вектор. В случае тензора 6x6x256, стандартной операцией будет преобразование его в одномерный вектор размером 9216 (6 6 256), что сохраняет все данные без потерь. Этот процесс позволяет подготовить данные для подачи в полносвязанные (fully connected, FC) слои. -

Переход к полносвязанным слоям (FC):

В архитектуре Алекснет из 9216-векторных нейронов формируется вход для первого полносвязанного слоя, содержащего 4096 нейронов. Этот переход не означает потерю информации, а скорее обобщает и преобразует данные для дальнейшей классификации. Здесь применяются стандартные методы нейронных сетей, такие как активационные функции и нормализация, что оптимизирует обучение и улучшает генерализуемость. -

Связь между сверточными и полносвязанными слоями:

Концептуально, необходимо помнить: 9216 нейронов, полученных после флэттенига, это не «новые» нейроны. Они лишь представляют линейные компоненты исходных сверточных выводов, которые затем передаются на полносвязанный слой без потерь информации, через веса и параметры слоя, чтобы обеспечить обучение сети.

Заключение

Таким образом, Алекснет не теряет размерность при переходе к 4096-неждерным полносвязанным слоям. Это число обусловлено архитектурным выбором, чтобы помочь сети обучаться более эффективно и быстро. Изучение изображения архитектуры и структуры сети также может помочь лучше понять, как функционируют диаграммы передачи данных внутри модели.

Надеюсь, это объяснение помогло прояснить процессы, происходящие в модели Алекснет. Для более глубокого понимания, рекомендуется изучать архитектурные схемы и конкретные реализации первого слоя полносвязанных нейронов в контексте других архитектур.